Claude Code + 本地模型:一套真正省钱又能干活的 AI 使用方案

原文链接:https://mp.weixin.qq.com/s/_sG0nrWERqT3jg7u9SjkJw 版权声明:本文版权归原文作者所有,仅供参考学习

Claude Code + 本地模型:一套真正"省钱又能干活"的 AI 使用方案

这几天很多人现在都在问一个问题:

👉 能不能不用花钱,还能用好 AI?

答案是:可以,但要用对方法。

这篇讲清楚一套非常实用的组合:

👉 Claude Code + 本地模型(如 Gemma 4)

核心逻辑就一句话:

👉 贵的负责思考,免费的负责干活

一、官方 Claude Code:强,但有成本

先说官方版本的情况

Claude Code 是 Anthropic 自家出的终端工具

特点:

- 只能用 Claude 模型

- 按调用收费

- 体验很好,但成本不低

👉 本质:性能强,但不自由

能不能破解?

理论上可以

需要做一件事:

👉 写一个"代理转发(Proxy)"

把 Claude 的请求转发给本地模型

常见方案:

- LiteLLM

但问题是:

- 👉 对普通人不友好

- 👉 折腾成本很高

- 👉 不建议新手走这条路

二、真正可用方案:开源平替工具

这才是重点

开源社区已经做了一批工具:

- OpenClaw

- Cline(VS Code 插件)

- Hermes

这些工具的特点:

- 👉 外观、体验接近 Claude

- 👉 但支持接入本地模型

- 👉 本质:自由 + 成本为 0

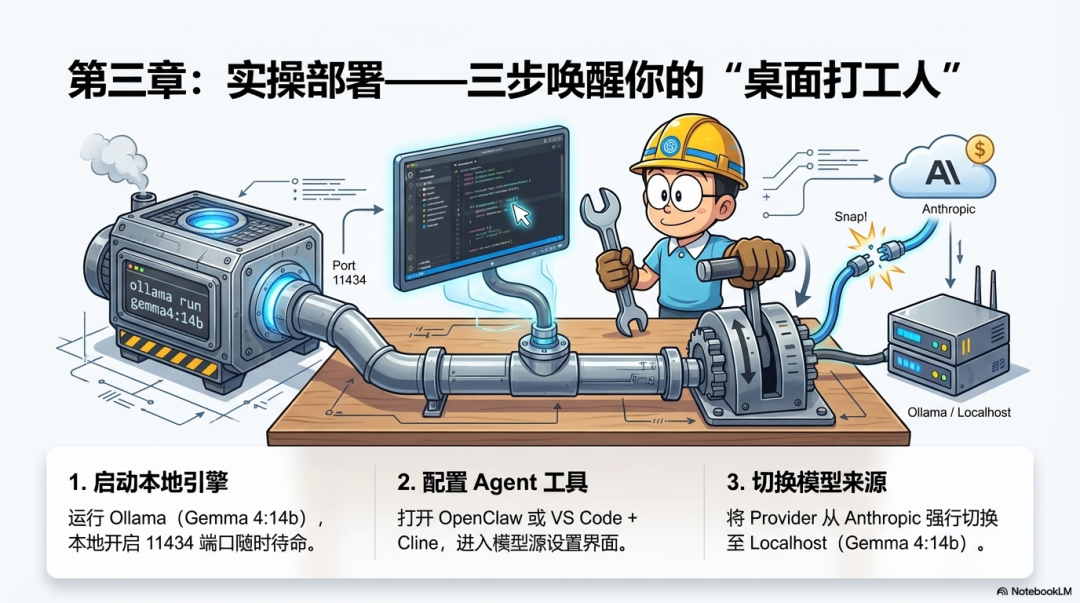

三、3步接入本地 Gemma 4(实操)

这里给你最简单的一套流程

第一步:把模型跑起来

用 Ollama

bash

ollama run gemma4:14b运行后:

- 👉 本地会开启一个端口(11434)

- 👉 随时可以调用

第二步:打开你的 Agent 工具

比如:

- OpenClaw

- VS Code + Cline

进入设置界面

第三步:切换模型来源

把 Provider(模型服务商)从 Anthropic 改成 Ollama / Localhost

然后选择 gemma4:14b

👉 到这里就完成了

你的工具已经变成:本地 AI 工作站

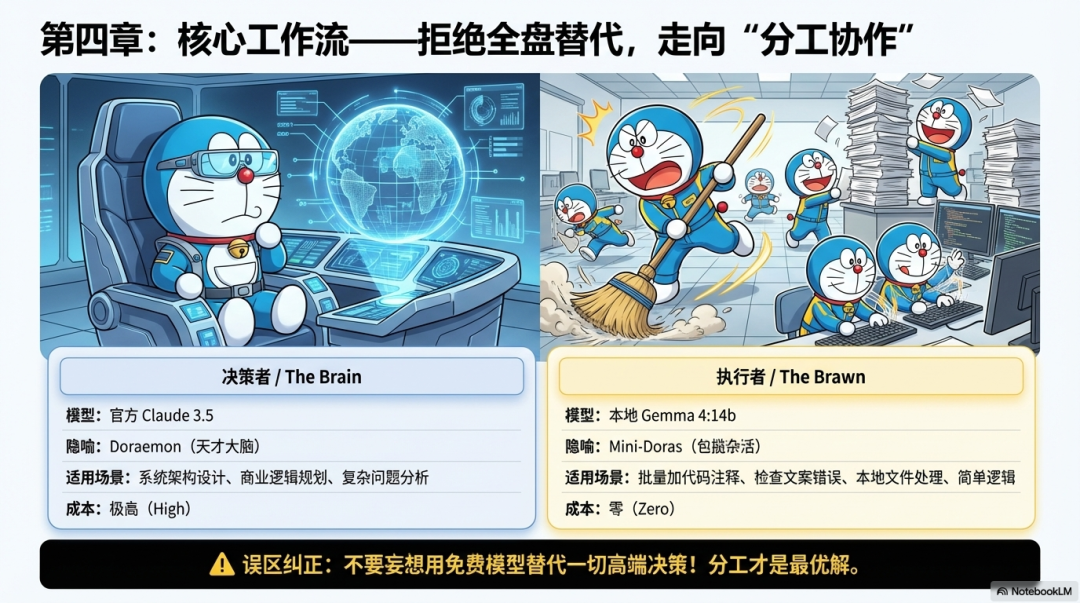

四、真正的用法:分工,而不是替代

很多人会犯一个错误:

👉 想用免费模型替代一切

但正确用法是:分工

1)让本地模型干"杂活"

比如:

- 批量加代码注释

- 检查文案错误

- 本地文件处理

- 简单逻辑任务

👉 这些全部用 Gemma 4 👉 成本:0

2)让高端模型做"决策"

当你遇到:

- 系统架构设计

- 商业逻辑规划

- 复杂问题分析

再切回 Claude

👉 用最强模型解决关键问题

五、本质是什么?

这套方案的核心,不是技术

而是:

👉 成本结构优化

简单理解:

免费模型 → 执行 付费模型 → 决策

👉 用最少的钱,做最多的事

最后一句话

很多人还在纠结:

👉 用哪个模型

但真正重要的是:

👉 怎么用模型

如果你把这套分工用明白了

AI 不再是成本

👉 而是你的"低成本劳动力"

版权声明:本文版权归原文作者所有 原文链接:https://mp.weixin.qq.com/s/_sG0nrWERqT3jg7u9SjkJw